Holdet

Lars Løberg Monstad

Administrerende direktør & medstifter

Lars er en dygtig Machine Learning-ingeniør og Full-Stack-udvikler med speciale i music information retrieval. Han har publiceret flere artikler inden for feltet og udviklet avancerede AI-modeller til musikanalyse og transkription. Som CEO og medstifter driver han virksomhedens vision og produktstrategi, hvor han kombinerer dyb teknisk ekspertise med iværksætterlederskab.

Dr. Olivier Lartillot

Chief Science Officer & medstifter

Førende forsker ved UiOs RITMO Centre for Interdisciplinary Studies in Rhythm, Time and Motion og professor ved MishMash Center for AI and Creativity. Var banebrydende med den hybride transformer-regelsystem-tilgang, der udgør kernen i vores transkriptionsteknologi. Over 20 års erfaring inden for computerbaseret musikvidenskab og MIR (Music Information Retrieval).

Karstein Grønnesby

Driftsdirektør

Karstein har en mastergrad i musikteknologi fra Universitetet i Oslo og bringer mange års erfaring med koordinering af projekter og produktioner i musiksektoren. Han leder projektledelse og B2B-siden af vores produkt og trækker på sin baggrund fra Samspill International Music Network og Norsk Viseforum. Han er også grundlæggeren af Blåsemaker, et værksted dedikeret til fremstilling af traditionelle norske blæseinstrumenter.

Vores mission

Vi mener, at musiktranskription bør være tilgængeligt for alle – fra elever, der vil lære deres yndlingssange, til professionelle musikere, der bevarer deres kompositioner. Vores AI-teknologi bygger bro mellem lyd og notation og gør nodeskabelse lige så nemt som at optage en performance.

Støttet af Norges Forskningsråd

Vores forskning

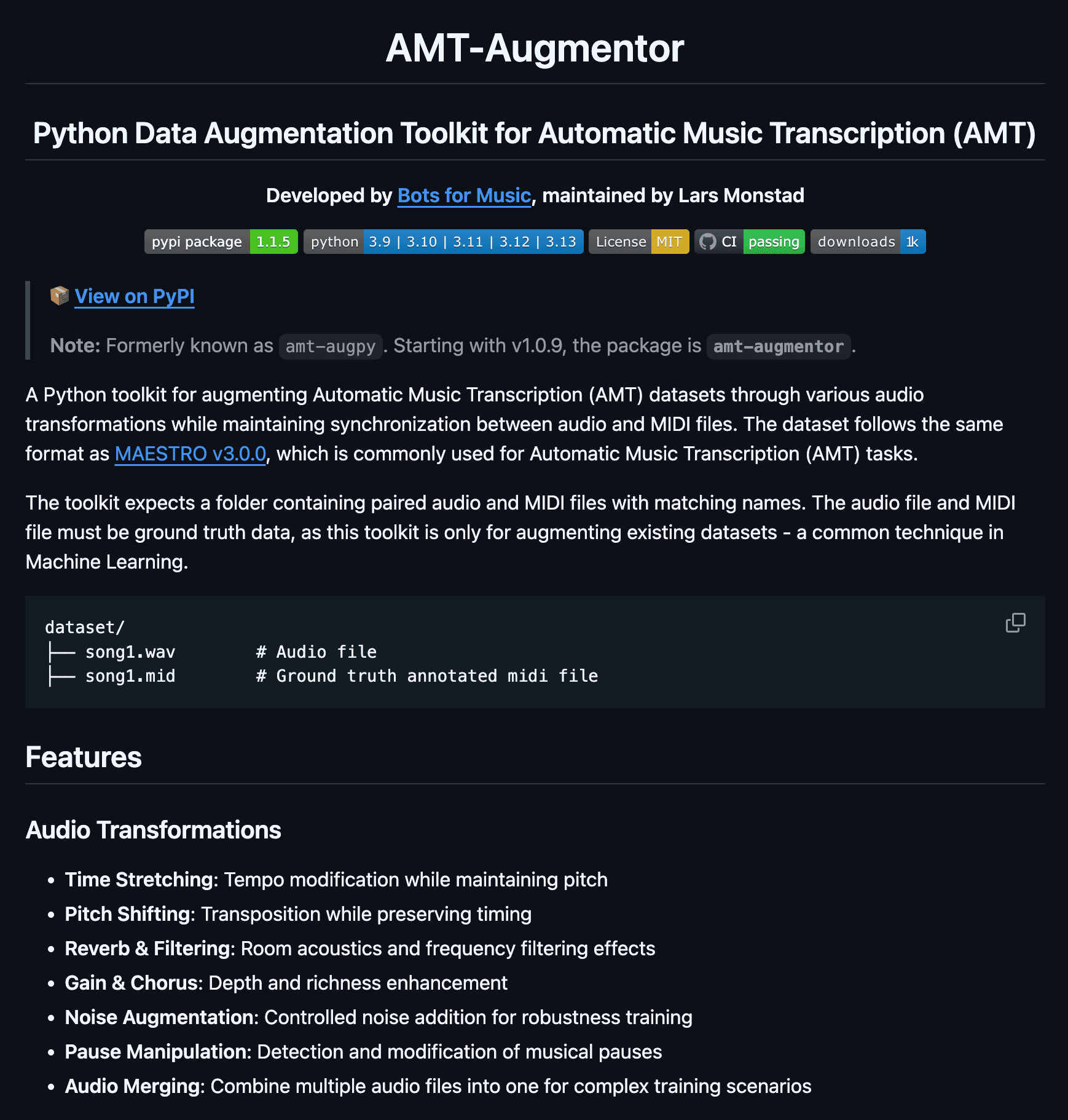

AMT-Augmentor

AMT-Augmentor er et Python-værktøjssæt til udvidelse af datasæt til Automatic Music Transcription (AMT) med lydtransformationer i høj kvalitet – timestretching, pitch-shifting, reverb/filtrering, støj, gain/chorus – med bevarelse af lyd-MIDI-synkronisering. Det er MAESTRO-kompatibelt, CLI-drevet og konfigurerbart via YAML, med parallel behandling og indbygget datasætvalidering/-opdeling for at accelerere robust AMT-modeltræning. Open source (MIT).

Se på GitHub

HF2: Hardanger Fiddle Dataset

Et åbent datasæt med parrede lyd- og MIDI-optagelser af norsk hardingfele, udviklet ved Universitetet i Oslo til træning og evaluering af modeller for lyd-til-MIDI-transskription. Det udvider det oprindelige HF1-datasæt til 119 lyd-MIDI-par fordelt på 39 unikke melodier (90.325 annoterede noder, ~970 MB) og introducerer emotionelle varianter — hver melodi er fremført i fem fortolkninger (original, vred, glad, trist, øm) — sammen med CSV-grundsandhed med højpræcise tonehøjdedata. Et forskningsdatasæt til musikinformationssøgningsmiljøet.

Se på GitHubSeneste publikationer

Se vores forskningsmodel i aktion

Livetranskription af hardingfelemusik hos MishMash Centre for AI and Creativity i Oslo · 08.04

I pressen

Shifter · Norske teknologinyheder