Teamet

Lars Løberg Monstad

Administrerende direktør og medgründer

Lars er en svært dyktig maskinlæringsingeniør og fullstack-utvikler som spesialiserer seg på musikkgjenfinning. Han har publisert flere artikler innen feltet og utviklet avanserte AI-modeller for musikkanalyse og transkripsjon. Som administrerende direktør og medgründer driver han selskapets visjon og produktstrategi, og kombinerer dyp teknisk kompetanse med gründerlederskap.

Dr. Olivier Lartillot

Forskningsdirektør og medgründer

Ledende forsker ved UiOs RITMO Senter for tverrfaglige studier i rytme, tid og bevegelse og professor ved MishMash-senteret for AI og kreativitet. Pioner innen den hybride transformer-regelsystem-tilnærmingen som utgjør kjernen i vår transkripsjonsteknologi. Over 20 års erfaring innen beregningsbasert musikkvitenskap og MIR (Music Information Retrieval).

Karstein Grønnesby

Driftsdirektør

Karstein har en mastergrad i musikkteknologi fra Universitetet i Oslo og har mange års erfaring med koordinering av prosjekter og produksjoner i musikksektoren. Han leder prosjektledelse og B2B-siden av produktet vårt, basert på sin bakgrunn fra Samspill International Music Network og Norsk Viseforum. Han er også grunnleggeren av Blåsemaker, et verksted for fremstilling av tradisjonelle norske blåseinstrumenter.

Vårt oppdrag

Vi tror at musikktranskripsjon bør være tilgjengelig for alle — fra elever som vil lære favorittsangene sine til profesjonelle musikere som vil bevare komposisjonene sine. Vår AI-teknologi bygger bro mellom lyd og notasjon, og gjør noteskriving like enkelt som å ta opp en fremføring.

Støttet av Norges forskningsråd

Forskningen vår

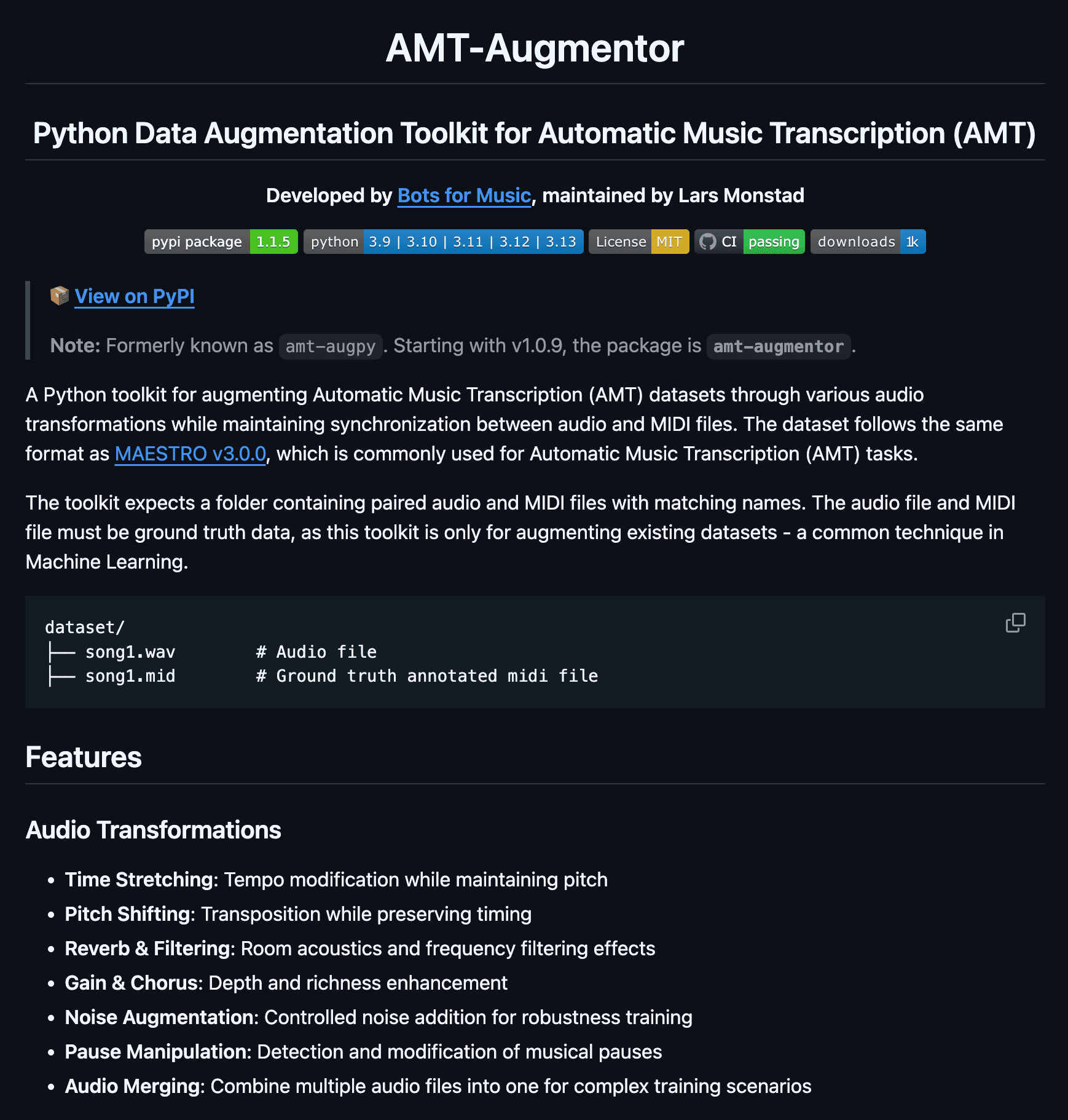

AMT-Augmentor

AMT-Augmentor er et Python-verktøy for å utvide datasett for automatisk musikktranskripsjon (AMT) med lydtransformasjoner av høy kvalitet — tidsstrekking, tonehøydeendring, romklang/filtrering, støy, forsterkning/kor — samtidig som lyd–MIDI-tilpasningen bevares. Det er MAESTRO-kompatibelt, CLI-drevet og konfigurerbart via YAML, med parallell prosessering og innebygd datasettvalidering/deling for å fremskynde robust AMT-modelltrening. Åpen kildekode (MIT).

Se på GitHub

HF2: Hardanger Fiddle Dataset

Et åpent datasett med parvise lyd–MIDI-opptak av norsk hardingfele, utviklet ved Universitetet i Oslo for trening og evaluering av modeller for lyd-til-MIDI-transkripsjon. Utvider det opprinnelige HF1-datasettet til 119 lyd–MIDI-par fordelt på 39 unike slåtter (90 325 annoterte noter, ~970 MB), og introduserer emosjonelle varianter — hver slått fremført i fem tolkninger (original, sint, glad, trist, øm) — sammen med CSV-fasit med høypresise tonehøydedata. Et forskningsdatasett for fagmiljøet innen musikkinformasjonsgjenfinning.

Se på GitHubNylige publikasjoner

Se forskningsmodellen vår i aksjon

Livetranskripsjon av hardingfelemusikk hos MishMash Centre for AI and Creativity i Oslo · 08.04

I pressen

Shifter · Norske teknologinyheter