Il team

Lars Løberg Monstad

Chief Executive Officer e co-fondatore

Lars è un esperto ingegnere di Machine Learning e sviluppatore Full-Stack specializzato nel music information retrieval. Ha pubblicato diversi articoli nel settore e sviluppato modelli IA avanzati per l'analisi e la trascrizione musicale. Come CEO e co-fondatore, guida la visione e la strategia di prodotto dell'azienda, combinando profonda competenza tecnica con leadership imprenditoriale.

Dr. Olivier Lartillot

Chief Science Officer e co-fondatore

Ricercatore di punta presso il Centro RITMO dell'UiO per gli studi interdisciplinari su ritmo, tempo e movimento e professore presso il MishMash Center for AI and Creativity. Ha ideato l'approccio ibrido transformer-regole che costituisce il nucleo della nostra tecnologia di trascrizione. Oltre 20 anni di esperienza nella musicologia computazionale e nel MIR (Music Information Retrieval).

Karstein Grønnesby

Chief Operating Officer

Karstein ha conseguito un Master in Tecnologia Musicale presso l'Università di Oslo e vanta anni di esperienza nel coordinamento di progetti e produzioni nel settore musicale. Supervisiona la gestione dei progetti e guida il lato B2B del nostro prodotto, attingendo alla sua esperienza presso Samspill International Music Network e Norsk Viseforum. È anche il fondatore di Blåsemaker, un laboratorio dedicato alla costruzione di strumenti a fiato tradizionali norvegesi.

La nostra missione

Crediamo che la trascrizione musicale debba essere accessibile a tutti — dagli studenti che imparano le loro canzoni preferite ai musicisti professionisti che preservano le loro composizioni. La nostra tecnologia IA colma il divario tra audio e notazione, rendendo la creazione di spartiti semplice come registrare un'esecuzione.

Supportato dal Consiglio Norvegese della Ricerca

La nostra ricerca

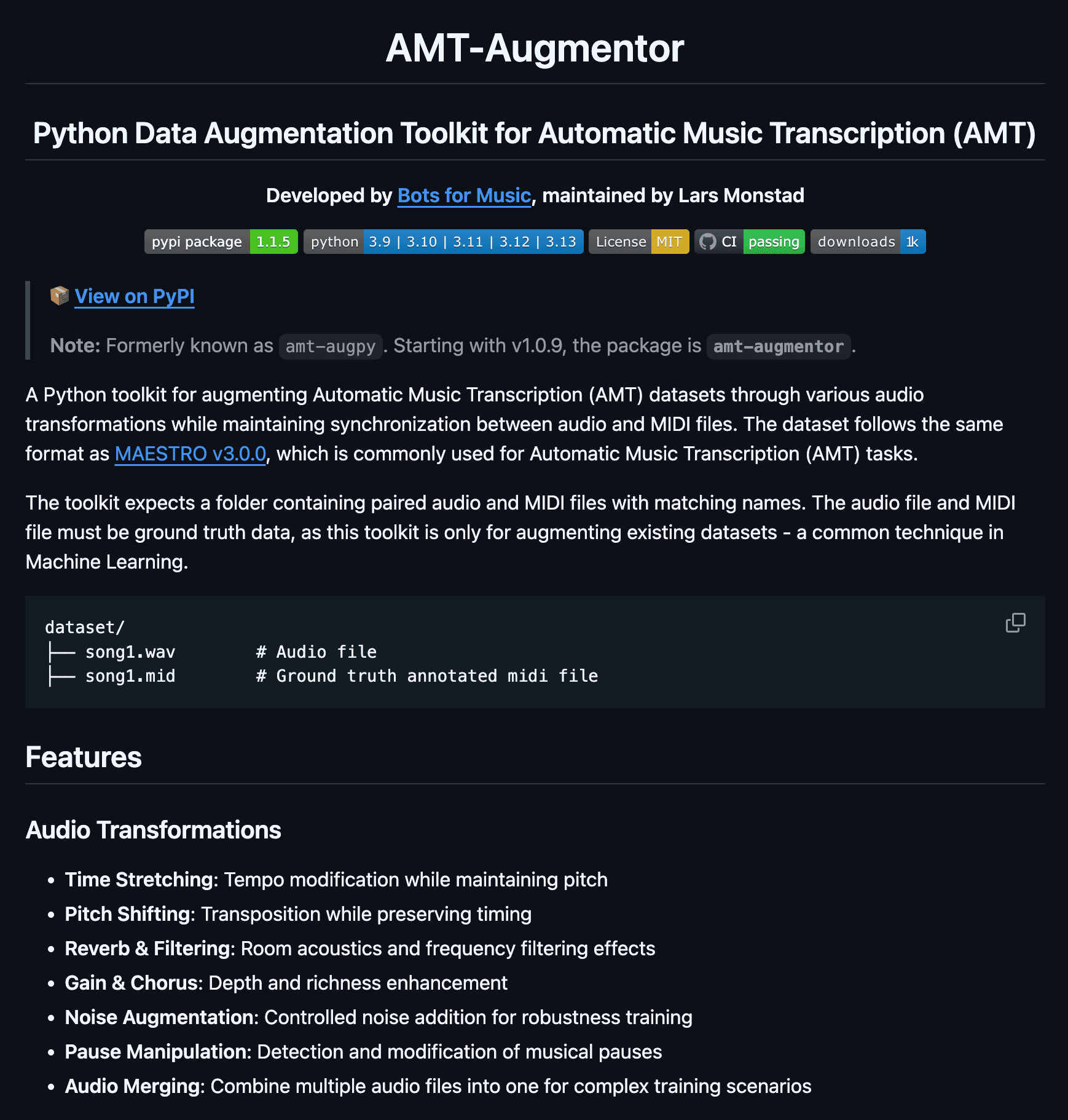

AMT-Augmentor

AMT-Augmentor è un toolkit Python per espandere i dataset di trascrizione musicale automatica (AMT) con trasformazioni audio di alta qualità — time-stretching, pitch-shifting, riverbero/filtraggio, rumore, gain/chorus — preservando l'allineamento audio-MIDI. È compatibile con MAESTRO, gestito da CLI e configurabile via YAML, con elaborazione parallela e validazione/suddivisione dei dataset integrata per accelerare l'addestramento di modelli AMT robusti. Open-source (MIT).

Vedi su GitHub

HF2: Hardanger Fiddle Dataset

Un dataset open accoppiato audio-MIDI di registrazioni di violino Hardanger norvegese, realizzato presso l'Università di Oslo per l'addestramento e la valutazione di modelli di trascrizione audio-MIDI. Estende il dataset originale HF1 a 119 coppie audio-MIDI distribuite su 39 brani unici (90.325 note annotate, ~970 MB) e introduce varianti emotive — ogni brano eseguito in cinque interpretazioni (originale, arrabbiato, allegro, triste, tenero) — insieme a una ground truth in CSV con dati di pitch ad alta precisione. Un dataset di ricerca per la comunità del music information retrieval.

Vedi su GitHubPubblicazioni recenti

Il nostro modello di ricerca in azione

Trascrizione dal vivo di musica per violino di Hardanger presso il MishMash Centre for AI and Creativity di Oslo · 08.04

Sulla stampa

Shifter · Notizie tech norvegesi