El equipo

Lars Løberg Monstad

Director Ejecutivo y Cofundador

Lars es un ingeniero de Machine Learning y desarrollador Full-Stack altamente cualificado, especializado en recuperación de información musical. Ha publicado varios artículos en el campo y ha desarrollado modelos avanzados de IA para análisis y transcripción musical. Como CEO y cofundador, impulsa la visión y la estrategia de producto de la empresa, combinando una profunda experiencia técnica con liderazgo emprendedor.

Dr. Olivier Lartillot

Director Científico y Cofundador

Investigador destacado en el Centro RITMO de Estudios Interdisciplinarios de Ritmo, Tiempo y Movimiento de la UiO y profesor en el Centro MishMash de IA y Creatividad. Fue pionero del enfoque híbrido transformer-reglas que constituye el núcleo de nuestra tecnología de transcripción. Más de 20 años de experiencia en musicología computacional y MIR (Recuperación de Información Musical).

Karstein Grønnesby

Director de Operaciones

Karstein tiene un Máster en Tecnología Musical de la Universidad de Oslo y aporta años de experiencia coordinando proyectos y producciones en el sector musical. Supervisa la gestión de proyectos y lidera el área B2B de nuestro producto, apoyándose en su experiencia en Samspill International Music Network y Norsk Viseforum. También es el fundador de Blåsemaker, un taller dedicado a la fabricación de instrumentos de viento tradicionales noruegos.

Nuestra Misión

Creemos que la transcripción musical debe ser accesible para todos, desde estudiantes aprendiendo sus canciones favoritas hasta músicos profesionales preservando sus composiciones. Nuestra tecnología de IA cierra la brecha entre el audio y la notación, haciendo que crear partituras sea tan sencillo como grabar una interpretación.

Apoyado por el Consejo de Investigación de Noruega

Nuestra Investigación

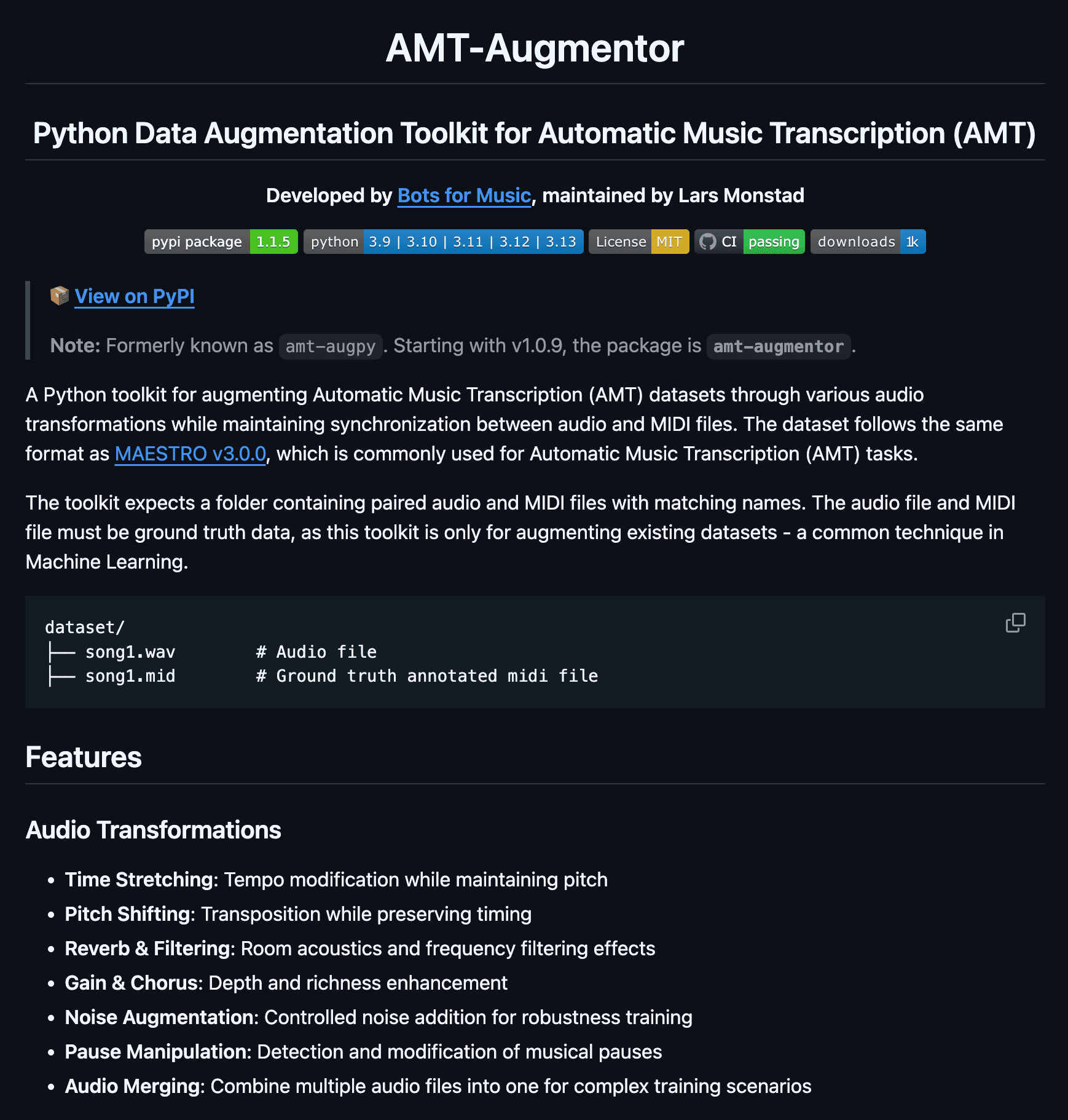

AMT-Augmentor

AMT-Augmentor es un toolkit de Python para expandir conjuntos de datos de Transcripción Musical Automática (AMT) con transformaciones de audio de alta calidad (time-stretching, pitch-shifting, reverb/filtrado, ruido, ganancia/chorus) preservando la alineación audio-MIDI. Es compatible con MAESTRO, se maneja por CLI y es configurable mediante YAML, con procesamiento en paralelo y validación/división de datos integrada para acelerar el entrenamiento robusto de modelos AMT. Código abierto (MIT).

Ver en GitHub

HF2: Hardanger Fiddle Dataset

Un conjunto de datos abierto de pares audio-MIDI de grabaciones del violín Hardanger noruego, desarrollado en la Universidad de Oslo para entrenar y evaluar modelos de transcripción de audio a MIDI. Amplía el conjunto de datos original HF1 a 119 pares audio-MIDI repartidos en 39 canciones únicas (90.325 notas anotadas, ~970 MB), e introduce variantes emocionales: cada canción interpretada en cinco versiones (original, enfadada, alegre, triste, tierna), junto con datos de referencia en CSV con información de tono de alta precisión. Un conjunto de datos de investigación para la comunidad de recuperación de información musical.

Ver en GitHubPublicaciones recientes

Nuestro modelo de investigación en acción

Transcripción en directo de música de violín Hardanger en el MishMash Centre for AI and Creativity de Oslo · 08.04

En la prensa

Shifter · Noticias tecnológicas noruegas