Das Team

Lars Løberg Monstad

Chief Executive Officer & Mitgründer

Lars ist ein hochqualifizierter Machine-Learning-Ingenieur und Full-Stack-Entwickler mit Spezialisierung auf Music Information Retrieval. Er hat mehrere Fachartikel veröffentlicht und fortschrittliche KI-Modelle für Musikanalyse und -transkription entwickelt. Als CEO und Mitgründer treibt er die Vision und Produktstrategie des Unternehmens voran und verbindet tiefgreifende technische Expertise mit unternehmerischer Führung.

Dr. Olivier Lartillot

Chief Science Officer & Mitgründer

Führender Forscher am RITMO Centre for Interdisciplinary Studies in Rhythm, Time and Motion der UiO und Professor am MishMash Center for AI and Creativity. Er entwickelte den hybriden Transformer-Regel-Systemansatz, der den Kern unserer Transkriptionstechnologie bildet. Über 20 Jahre Erfahrung in computergestützter Musikwissenschaft und MIR (Music Information Retrieval).

Karstein Grønnesby

Chief Operating Officer

Karstein hat einen Master in Musiktechnologie von der Universität Oslo und bringt jahrelange Erfahrung in der Koordination von Projekten und Produktionen im Musikbereich mit. Er leitet das Projektmanagement und den B2B-Bereich unseres Produkts, gestützt auf seine Erfahrung bei Samspill International Music Network und Norsk Viseforum. Er ist außerdem Gründer von Blåsemaker, einer Werkstatt für die Herstellung traditioneller norwegischer Blasinstrumente.

Unsere Mission

Wir glauben, dass Musiktranskription für alle zugänglich sein sollte — von Schülern, die ihre Lieblingssongs lernen, bis zu professionellen Musikern, die ihre Kompositionen bewahren. Unsere KI-Technologie überbrückt die Lücke zwischen Audio und Notation und macht die Notenerstellung so einfach wie eine Aufnahme.

Unterstützt vom Norwegischen Forschungsrat

Unsere Forschung

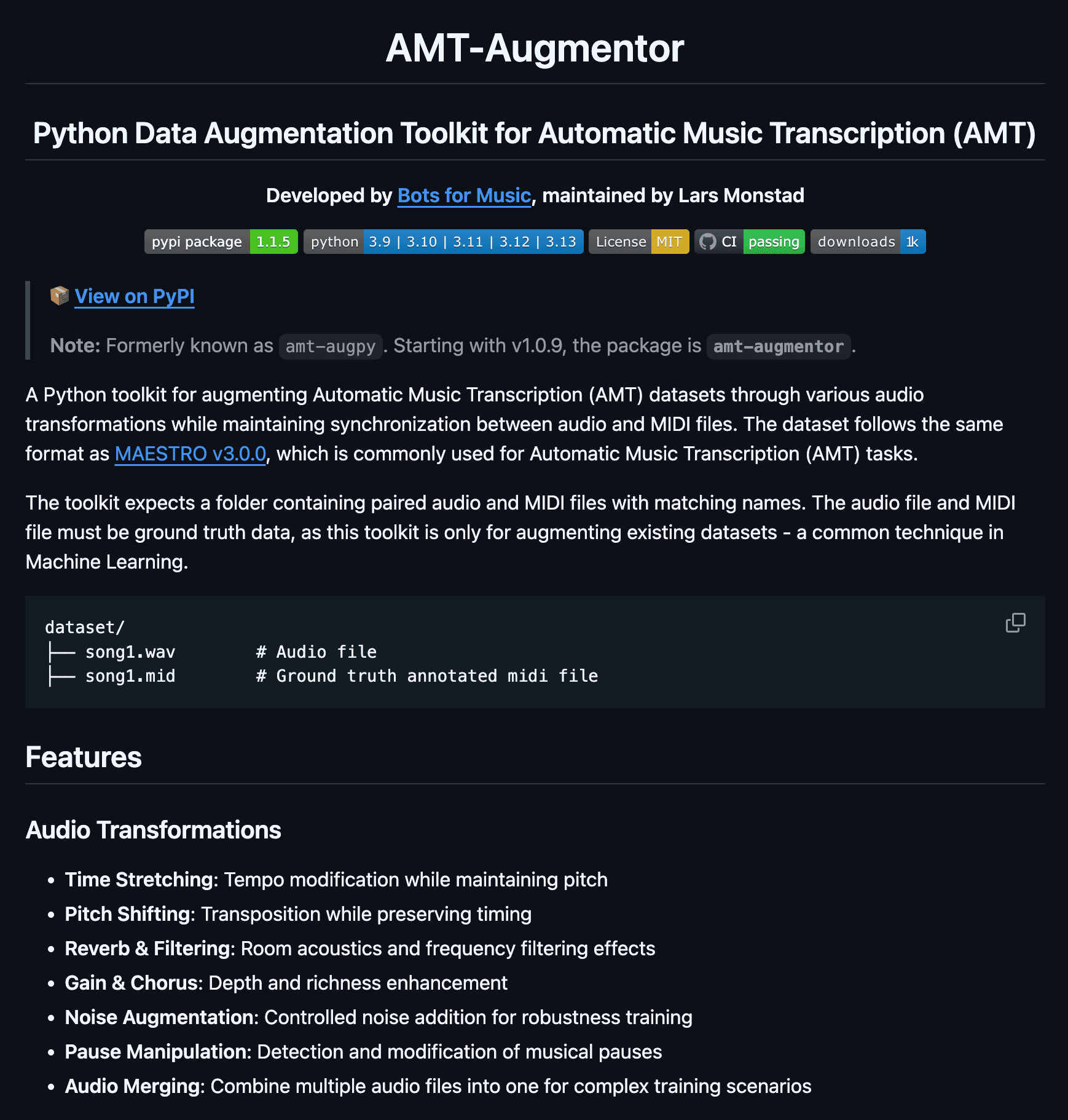

AMT-Augmentor

AMT-Augmentor ist ein Python-Toolkit zur Erweiterung von Datensätzen für automatische Musiktranskription (AMT) mit hochwertigen Audio-Transformationen — Time-Stretching, Pitch-Shifting, Reverb/Filterung, Rauschen, Gain/Chorus — unter Beibehaltung der Audio-MIDI-Ausrichtung. Es ist MAESTRO-kompatibel, CLI-gesteuert und über YAML konfigurierbar, mit Parallelverarbeitung und integrierter Datensatzvalidierung/-aufteilung zur Beschleunigung des robusten AMT-Modelltrainings. Open Source (MIT).

Auf GitHub ansehen

HF2: Hardanger Fiddle Dataset

Ein offener, gepaarter Audio-MIDI-Datensatz norwegischer Hardangerfiedel-Aufnahmen, erstellt an der Universität Oslo zum Training und zur Evaluierung von Audio-zu-MIDI-Transkriptionsmodellen. Erweitert den ursprünglichen HF1-Datensatz auf 119 Audio-MIDI-Paare über 39 einzigartige Stücke (90.325 annotierte Noten, ~970 MB) und führt emotionale Varianten ein — jedes Stück in fünf Interpretationen aufgeführt (Original, wütend, fröhlich, traurig, zärtlich) — zusammen mit CSV-Ground-Truth mit hochpräzisen Tonhöhendaten. Ein Forschungsdatensatz für die Music-Information-Retrieval-Community.

Auf GitHub ansehenAktuelle Veröffentlichungen

Unser Forschungsmodell in Aktion

Live-Transkription von Hardanger-Fiedel-Musik am MishMash Centre for AI and Creativity in Oslo · 08.04

In der Presse

Shifter · Norwegische Tech-News